Der neue Chatbot aus Deepseek, der kühn erklärte: "Hallo, ich wurde erstellt, damit Sie alles fragen und eine Antwort erhalten, die Sie sogar überraschen könnte", hat in der KI -Branche bedeutende Wellen geführt. Diese Einführung hat nicht nur Aufmerksamkeit erregt, sondern auch zu einem der größten Aktienkursabfälle von NVIDIA beigetragen und Deepseeks Auswirkungen auf den Markt darstellt.

Bild: Ensigame.com

Bild: Ensigame.com

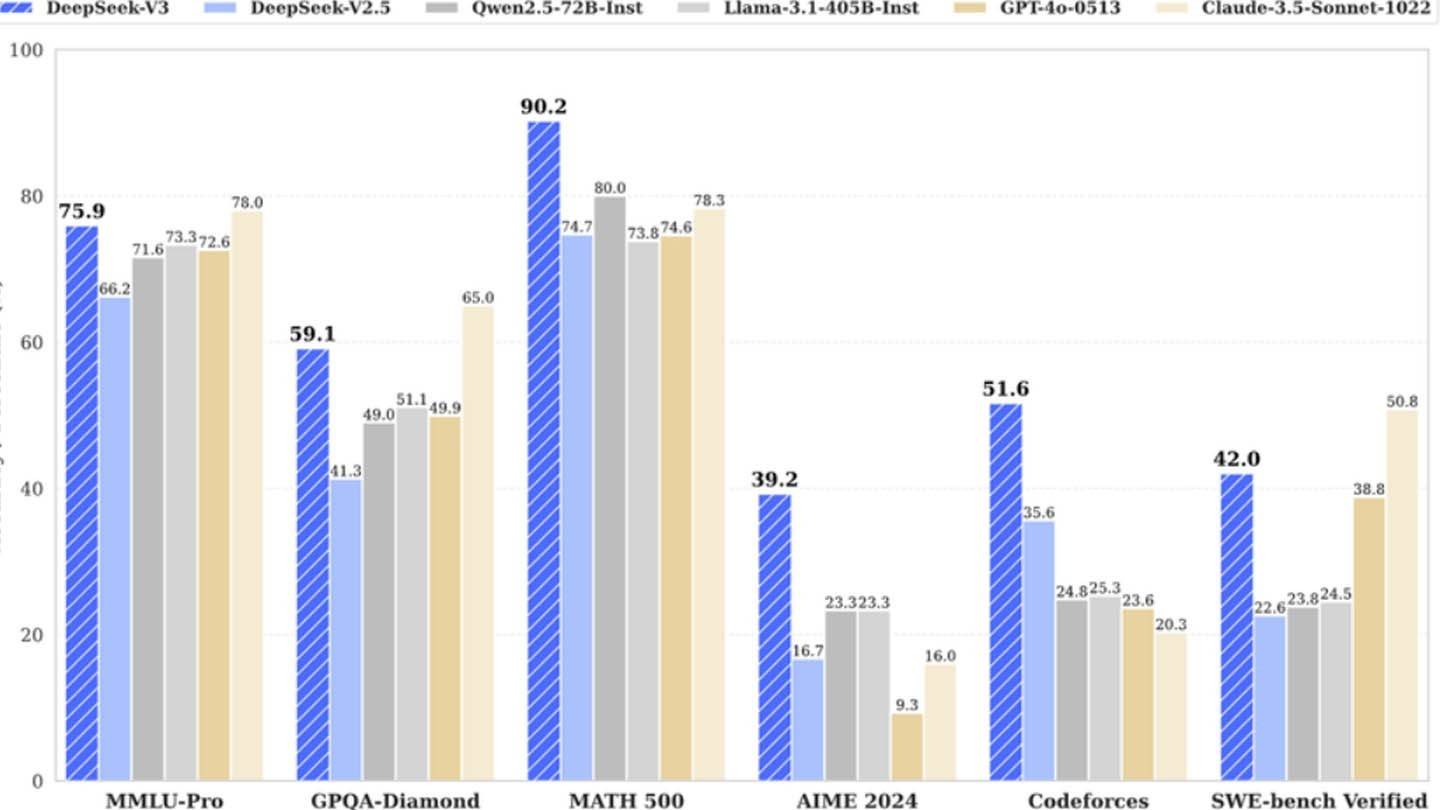

Das KI -Modell von Deepseek stammt aufgrund seiner innovativen Architektur- und Trainingsmethoden. Lassen Sie uns mit den Schlüsseltechnologien eintauchen, die sie auszeichnen:

Multi-Token-Vorhersage (MTP) : Mit dieser Methode kann das Modell mehrere Wörter gleichzeitig vorhergesagt, indem verschiedene Segmente eines Satzes analysiert werden. Dies steigert nicht nur die Genauigkeit, sondern auch die Effizienz des Modells, was es zu einem leistungsstarken Werkzeug zum Verständnis und Generieren von Text macht.

Mischung von Experten (MOE) : Deepseek V3 verwendet eine hoch entwickelte Architektur mit 256 neuronalen Netzwerken, die acht für jede Token -Verarbeitungsaufgabe aktiviert. Dieser Ansatz beschleunigt das KI -Training erheblich und verbessert die Gesamtleistung und macht es zu einem herausragenden Merkmal ihrer Technologie.

Multi-Head Latent Achtung (MLA) : Dieser Mechanismus konzentriert sich auf die wichtigsten Teile eines Satzes und extrahiert wiederholte Schlüsseldetails. Auf diese Weise reduziert MLA das Risiko, wichtige Informationen zu fehlen, sodass die KI nuancierte Details in den Eingabedaten effektiv erfassen kann.

Deepseek, ein prominentes chinesisches Startup, behauptet, dieses wettbewerbsfähige KI -Modell zu relativ geringen Kosten entwickelt zu haben. Sie behaupten, dass die Ausbildung des leistungsstarken Deepseek V3 Neural Network sie nur 6 Millionen US -Dollar gekostet und nur 2048 Grafikprozessoren verwendet.

Bild: Ensigame.com

Bild: Ensigame.com

Analysten der semianalyse haben jedoch aufgedeckt, dass Deepseeks Operationen eine viel größere Computerinfrastruktur beinhalten. Sie schätzen, dass Deepseek ungefähr 50.000 NVIDIA Hopper -GPUs, einschließlich 10.000 H800 -Einheiten, 10.000 H100 und zusätzlichen H20 -GPUs, in mehreren Rechenzentren verbreitet. Diese Ressourcen werden für KI -Schulungen, Forschung und Finanzmodellierung verwendet, wobei die Gesamtinvestition des Unternehmens in Server rund 1,6 Milliarden US -Dollar und Betriebskosten bei 944 Mio. USD erzielen.

Deepseek ist eine Tochtergesellschaft des chinesischen Hedgefonds-High-Flyer, das es 2023 als separate KI-fokussierte Abteilung etabliert hat. Im Gegensatz zu vielen Startups, die sich auf Cloud Computing verlassen, besitzt Deepseek seine Rechenzentren und bietet ihm die vollständige Kontrolle über die AI-Modelloptimierung und eine schnellere Innovations-Bereitstellung. Der selbstfinanzierte Status des Unternehmens verbessert seine Beweglichkeit und Entscheidungsgeschwindigkeit.

Bild: Ensigame.com

Bild: Ensigame.com

Darüber hinaus zieht Deepseek Top -Talente von führenden chinesischen Universitäten an, wobei einige Forscher jährlich über 1,3 Millionen US -Dollar verdienen. Trotz dieser erheblichen Investitionen erscheint der Anspruch des Unternehmens, sein jüngstes Modell für nur 6 Millionen US-Dollar auszubilden, unrealistisch, da diese Zahl nur die GPU-Verwendung während der Vorausbildung ausmacht und andere wesentliche Kosten wie Forschung, Modellverfeinerung, Datenverarbeitung und Infrastruktur ausschließt.

Seit seiner Gründung hat Deepseek über 500 Millionen US -Dollar in die KI -Entwicklung investiert. Die kompakte Struktur ermöglicht es ihm, KI -Innovationen schnell und effektiv umzusetzen, im Gegensatz zu größeren, bürokratischeren Unternehmen.

Bild: Ensigame.com

Bild: Ensigame.com

Das Beispiel von Deepseek zeigt, dass ein gut finanziertes, unabhängiges KI-Unternehmen mit Branchenriesen konkurrieren kann. Während der Erfolg des Unternehmens von erheblichen Investitionen, technischen Durchbrüchen und einem starken Team getrieben wird, kann der Begriff eines "revolutionären Budgets" für die Entwicklung der KI -Modellentwicklung überbewertet werden. Trotzdem bleiben die Kosten von Deepseek deutlich niedriger als die seiner Konkurrenten, wie beispielsweise die 100 Millionen US -Dollar, die für die Ausbildung von ChatGPT4O ausgegeben wurden, im Vergleich zu 5 Millionen US -Dollar von Deepseek für R1.

Es ist jedoch immer noch billiger als seine Konkurrenten.

Heim

Heim  Navigation

Navigation

Neueste Artikel

Neueste Artikel

Neueste Spiele

Neueste Spiele