Il nuovo chatbot di DeepSeek, che affermava audacemente: "Ciao, sono stato creato in modo da poter chiedere qualsiasi cosa e ottenere una risposta che potrebbe persino sorprenderti", ha fatto ondate significative nel settore dell'intelligenza artificiale. Questa introduzione non solo ha catturato l'attenzione, ma ha anche contribuito a uno dei maggiori calo dei prezzi delle azioni di Nvidia, mettendo in mostra l'impatto di Deepseek sul mercato.

Immagine: Ensigame.com

Immagine: Ensigame.com

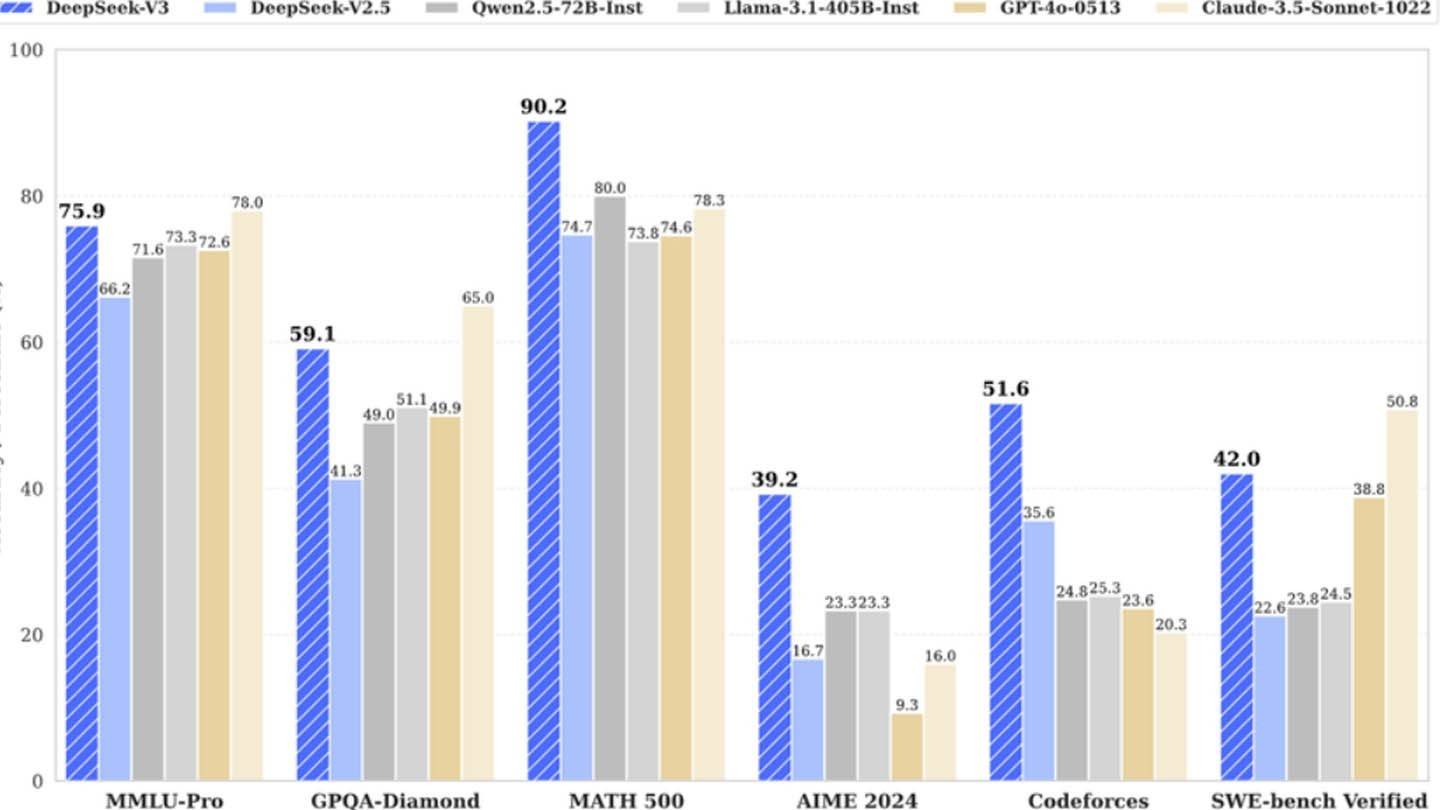

Il modello AI di Deepseek si distingue per la sua architettura e i metodi di formazione innovativi. Approfondiamo le tecnologie chiave che lo distinguono:

Multi-Token Prediction (MTP) : questo metodo consente al modello di prevedere più parole contemporaneamente analizzando diversi segmenti di una frase. Ciò non solo aumenta l'accuratezza, ma anche l'efficienza del modello, rendendolo uno strumento potente per comprendere e generare testo.

Miscela di esperti (MOE) : DeepSeek V3 utilizza un'architettura sofisticata con 256 reti neurali, attivando otto per ogni attività di elaborazione dei token. Questo approccio accelera significativamente l'allenamento dell'intelligenza artificiale e migliora le prestazioni complessive, rendendolo una caratteristica straordinaria della loro tecnologia.

Attenzione latente multi-testa (MLA) : questo meccanismo si concentra sulle parti più cruciali di una frase, estraendo ripetutamente i dettagli chiave. In tal modo, MLA riduce il rischio di perdere informazioni importanti, consentendo all'IA di acquisire dettagli sfumati nei dati di input in modo efficace.

DeepSeek, un'importante startup cinese, afferma di aver sviluppato questo modello di intelligenza artificiale competitivo a un costo relativamente basso. Affermano che la formazione della potente rete neurale di DeepSeek V3 è costata solo $ 6 milioni e ha utilizzato solo 2048 processori grafici.

Immagine: Ensigame.com

Immagine: Ensigame.com

Tuttavia, gli analisti della semianalisi hanno scoperto che le operazioni di Deepseek comportano un'infrastruttura computazionale molto più ampia. Stimano che DeepSeek utilizzi circa 50.000 GPU di Nvidia Hopper, tra cui 10.000 unità H800, 10.000 H100 e GPU H20 aggiuntive, diffuse in diversi data center. Queste risorse vengono utilizzate per la formazione, la ricerca e la modellazione finanziaria dell'IA, con l'investimento totale della società nei server che raggiunge circa $ 1,6 miliardi e spese operative a $ 944 milioni.

DeepSeek è una filiale dell'Hedge Fund cinese High-Flyer, che lo ha stabilito come una divisione separata focalizzata sull'intelligenza artificiale nel 2023. A differenza di molte startup che si basano sul cloud computing, DeepSeek possiede i suoi data center, dandole un controllo completo sull'ottimizzazione del modello AI e la più rapida innovazione innovativa. Lo status di autofinanziato dell'azienda migliora la sua velocità di agilità e processo decisionale.

Immagine: Ensigame.com

Immagine: Ensigame.com

Inoltre, DeepSeek attira i migliori talenti dalle principali università cinesi, con alcuni ricercatori che guadagnano oltre $ 1,3 milioni all'anno. Nonostante questi investimenti significativi, la pretesa della società di addestrare il suo ultimo modello per soli $ 6 milioni sembra irrealistica, poiché questa cifra rappresenta solo l'utilizzo della GPU durante il pre-allenamento ed esclude altri costi sostanziali come ricerca, perfezionamento del modello, elaborazione dei dati e infrastrutture.

Dalla sua fondazione, Deepseek ha investito oltre $ 500 milioni in sviluppo dell'IA. La sua struttura compatta gli consente di implementare innovazioni di intelligenza artificiale in modo rapido ed efficace, a differenza delle aziende più grandi e burocratiche.

Immagine: Ensigame.com

Immagine: Ensigame.com

L'esempio di Deepseek illustra che un'azienda di intelligenza artificiale indipendente ben finanziata può competere con i giganti del settore. Mentre il successo dell'azienda è guidato da investimenti sostanziali, scoperte tecniche e un team forte, la nozione di "budget rivoluzionario" per lo sviluppo del modello di intelligenza artificiale può essere sopravvalutata. Tuttavia, i costi di Deepseek rimangono significativamente inferiori a quelli dei suoi concorrenti, come i 100 milioni di dollari spesi per la formazione di GATGPT4O rispetto ai $ 5 milioni di DeepSeek per R1.

Tuttavia, è ancora più economico dei suoi concorrenti.

Casa

Casa  Navigazione

Navigazione

Ultimi articoli

Ultimi articoli

Ultimi giochi

Ultimi giochi