Chatbot baru dari Deepseek, yang dengan berani menyatakan, "Hai, saya dicipta supaya anda boleh meminta apa -apa dan mendapatkan jawapan yang mungkin mengejutkan anda," telah membuat gelombang penting dalam industri AI. Pengenalan ini bukan sahaja menarik perhatian tetapi juga menyumbang kepada salah satu penurunan harga saham terbesar Nvidia, yang mempamerkan kesan DeepSeek di pasaran.

Imej: ensigame.com

Imej: ensigame.com

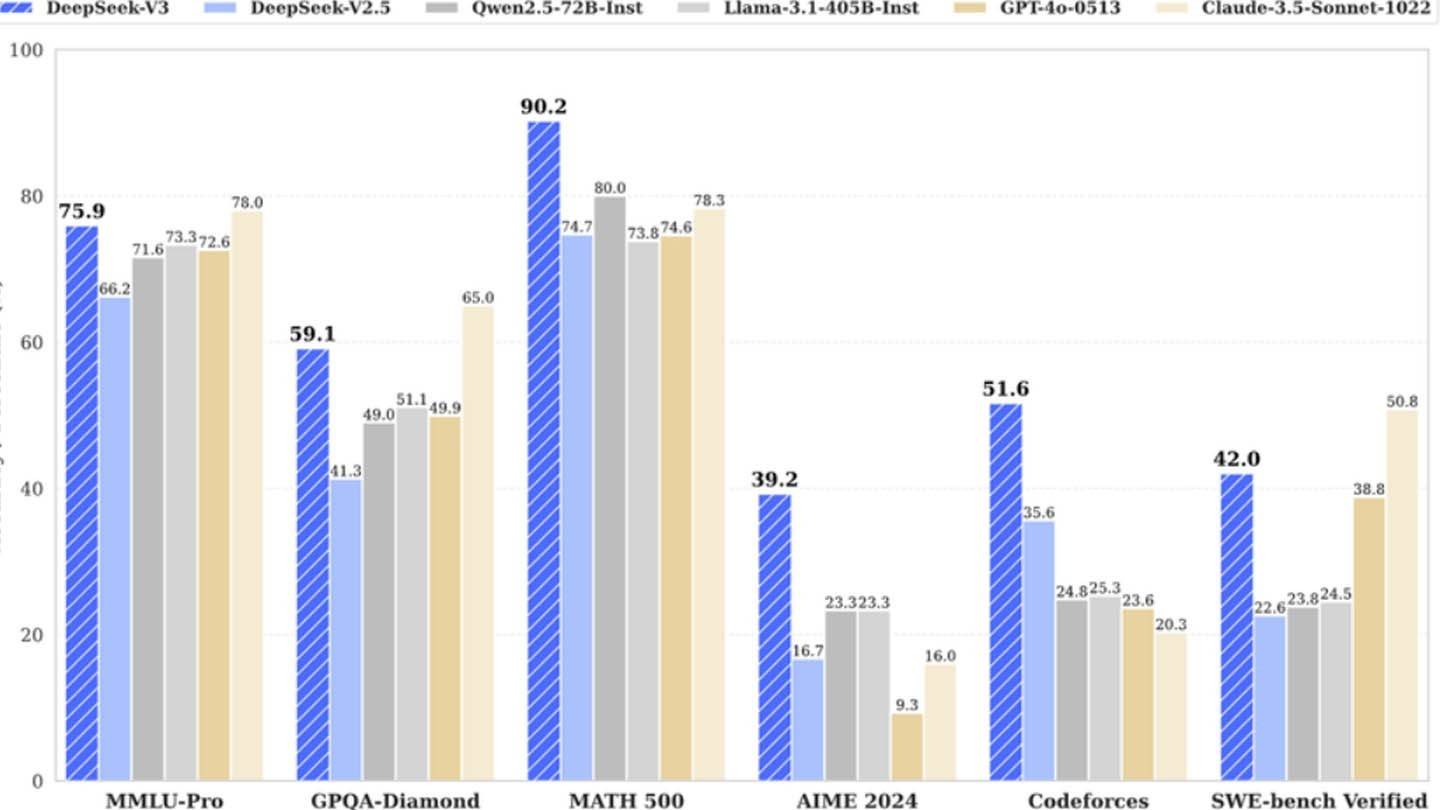

Model AI Deepseek menonjol kerana kaedah seni bina dan latihan yang inovatif. Mari kita menyelidiki teknologi utama yang membezakannya:

Ramalan Multi-Token (MTP) : Kaedah ini membolehkan model meramalkan beberapa perkataan sekaligus dengan menganalisis segmen yang berbeza dari ayat. Ini bukan sahaja meningkatkan ketepatan tetapi juga kecekapan model, menjadikannya alat yang berkuasa untuk memahami dan menghasilkan teks.

Campuran Pakar (MOE) : DeepSeek V3 menggunakan seni bina yang canggih dengan 256 rangkaian saraf, mengaktifkan lapan untuk setiap tugas pemprosesan token. Pendekatan ini dengan ketara mempercepat latihan AI dan meningkatkan prestasi keseluruhan, menjadikannya ciri -ciri teknologi mereka.

Perhatian Laten Multi-Head (MLA) : Mekanisme ini memberi tumpuan kepada bahagian-bahagian yang paling penting dalam satu kalimat, mengekstrak butiran utama berulang kali. Dengan berbuat demikian, MLA mengurangkan risiko maklumat penting yang hilang, yang membolehkan AI menangkap butiran nuanced dalam data input dengan berkesan.

DeepSeek, permulaan Cina yang terkenal, mendakwa telah membangunkan model AI yang kompetitif ini dengan kos yang agak rendah. Mereka menegaskan bahawa latihan rangkaian neural DeepSeek V3 yang kuat hanya berharga $ 6 juta dan hanya menggunakan pemproses grafik 2048.

Imej: ensigame.com

Imej: ensigame.com

Walau bagaimanapun, penganalisis dari semianalysis telah mendedahkan bahawa operasi DeepSeek melibatkan infrastruktur pengiraan yang lebih besar. Mereka menganggarkan bahawa DeepSeek menggunakan kira -kira 50,000 GPU NVIDIA Hopper, termasuk 10,000 unit H800, 10,000 H100S, dan GPU tambahan H20, tersebar di beberapa pusat data. Sumber -sumber ini digunakan untuk latihan AI, penyelidikan, dan pemodelan kewangan, dengan jumlah pelaburan syarikat dalam pelayan mencapai sekitar $ 1.6 bilion dan perbelanjaan operasi pada $ 944 juta.

DeepSeek adalah anak syarikat dana lindung nilai Cina yang tinggi, yang menubuhkannya sebagai bahagian yang fokus pada AI pada tahun 2023. Tidak seperti banyak pemula yang bergantung kepada pengkomputeran awan, DeepSeek memiliki pusat datanya, memberikannya kawalan sepenuhnya ke atas pengoptimuman model AI dan penggunaan inovasi yang lebih cepat. Status pembiayaan sendiri syarikat meningkatkan kelajuan ketangkasan dan keputusannya.

Imej: ensigame.com

Imej: ensigame.com

Tambahan pula, DeepSeek menarik bakat teratas dari universiti -universiti China yang terkemuka, dengan beberapa penyelidik memperoleh lebih dari $ 1.3 juta setahun. Walaupun pelaburan yang signifikan ini, tuntutan syarikat untuk melatih model terkini untuk hanya $ 6 juta nampaknya tidak realistik, kerana angka ini hanya menyumbang penggunaan GPU semasa latihan pra-latihan dan tidak termasuk kos besar lain seperti penyelidikan, penghalusan model, pemprosesan data, dan infrastruktur.

Sejak penubuhannya, DeepSeek telah melabur lebih daripada $ 500 juta dalam pembangunan AI. Struktur padatnya membolehkannya melaksanakan inovasi AI dengan cepat dan berkesan, tidak seperti syarikat birokrasi yang lebih besar dan lebih besar.

Imej: ensigame.com

Imej: ensigame.com

Contoh DeepSeek menggambarkan bahawa syarikat AI yang dibiayai dengan baik dapat bersaing dengan gergasi industri. Walaupun kejayaan syarikat didorong oleh pelaburan yang besar, penemuan teknikal, dan pasukan yang kuat, tanggapan tentang "anggaran revolusioner" untuk pembangunan model AI dapat diabaikan. Walau bagaimanapun, kos DeepSeek kekal jauh lebih rendah daripada pesaingnya, seperti $ 100 juta yang dibelanjakan untuk latihan chatgpt4o berbanding $ 5 juta DeepSeek untuk R1.

Walau bagaimanapun, ia masih lebih murah daripada pesaingnya.

Rumah

Rumah  Navigasi

Navigasi

Artikel terkini

Artikel terkini

Permainan Terkini

Permainan Terkini